Искусственный интеллект и сознание: imitation game

«Причины действий человеческих обыкновенно бесчисленно сложнее и разнообразнее, чем мы их всегда потом объясняем, и редко определенно очерчиваются».

Ф. М. Достоевский. Идиот

«Если нечто выглядит как утка, плавает как утка и крякает как утка, то это, вероятно, и есть утка. Или нет?..»

Утиный тест

«Can’t you see? The machine STUPIDLY follows whatever you tell it to do».

Профессор Линь, Национальный университет науки и технологии Тайваня

В прошлый раз мы говорили о том, что сам термин «искусственный интеллект» является предметом дискуссии и вопрос о том, является ли мышление прерогативой человека и как оно работает, волновал человечество задолго до появления первого компьютера. Естественным образом возник вопрос: есть ли эмпирический способ проверить, может ли машина мыслить?

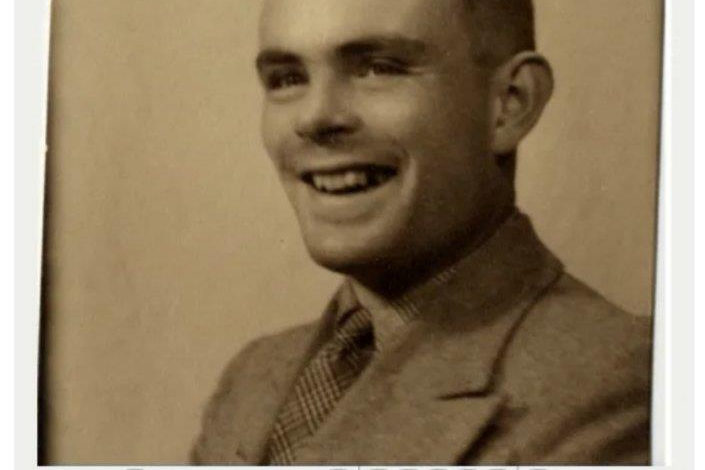

В 1950 году в философском журнале “Mind” выходит статья Алана Тьюринга «Вычислительные машины и разум». Тьюринг занимался этой проблематикой ещё с 40-х годов и был членом «Ratio Club» — неформальной группы британских кибернетиков и исследователей в области электроники. Однако такая формулировка прозвучала в науке впервые. Статья начиналась утверждением: «Я предлагаю рассмотреть вопрос „Могут ли машины думать?“». Тьюринг предложил следующий тест: «Человек взаимодействует с одним компьютером и одним человеком. На основании ответов на вопросы он должен определить, с кем он разговаривает: с человеком или компьютерной программой. Задача компьютерной программы — ввести человека в заблуждение, заставив сделать неверный выбор». Обязательным условием является то, что все участники теста не видят друг друга. Если судья не может определить, с кем он пообщался, – машина прошла тест. Беседа должна происходить в форме переписки, чтобы тестировался именно интеллект машины, а не способность распознавать речь. Промежутки между репликами тоже принимались во внимание, потому что тогда компьютеры реагировали медленнее, чем человек (сейчас время по-прежнему важно, но теперь потому, что компьютеры отвечают, наоборот, быстрее!). А как вы думаете – тест Тьюринга действительно проверяет умение мыслить или умение имитировать мыслительный процесс?

Тест Тьюринга неоднократно подвергался критике. Дело в том, что он проверяет не столько способность мыслить, сколько способность реагировать как человек. Вопрос: а всегда ли можно наше поведение назвать рациональным? И если уж притворяться человеком, то машине придется научиться выдавать парадоксальные реакции и творческие идеи, а кроме того, скрывать своё умение выполнять некоторые процедуры эффективнее, чем человек. Кроме того, очень знаменито возражение с точки зрения сознания, высказанное Джефферсоном на Листеровских чтениях 1949 года (Jefferson, 1949): «До тех пор, пока машина не сможет написать сонет или сочинить музыкальное произведение, побуждаемая к тому собственными мыслями и эмоциями, а не за счет случайного совпадения символов, мы не можем согласиться с тем, что она равносильна мозгу, т. е. что она может не только написать эти вещи, но и понять то, что ею написано. Ни один механизм не может чувствовать (а не просто искусственно индуцировать, для чего требуется достаточно несложное устройство) радость от своих успехов, горе от постигших его неудач, удовольствие от лести, огорчение из-за совершенной ошибки, не может быть очарованным противоположным полом, не может сердиться или быть удрученным, если ему не удается добиться желаемого». В своей самой радикальной форме это возражение означало бы, что, если мы хотим удостовериться, что машина способна к мышлению, мы должны сами стать машиной (вот это поворот), а потом описать свои мысли и ощущения тем, кто будет готов это всё выслушать (обычно желающих мало).

Тем не менее тест Тьюринга – это классика теории ИИ, и он помогает многое понять не только о машинах, но и о нас самих.

В качестве контраргумента к тесту Тьюринга часто упоминают «китайскую комнату» Сёрла – мысленный эксперимент в области философии сознания и философии искусственного интеллекта, который был опубликован в 1980 году в статье «Minds, Brains, and Programs» журнала «The Behavioral and Brain Sciences». Эксперимент вызвал настолько широкий резонанс, что статья вышла с 27 возражениями специалистов по когнитивистике и ответами Сёрла на них. Проведём этот мысленный опыт и мы. Итак, представим себе Джона Сёрля, заточенного в комнате с книгой, где подробно описано, как использовать китайские иероглифы. При этом ни единого иероглифа Джон Сёрл не знает (кажется, я помню это ощущение. — Прим. автора). В книге нет информации о значении иероглифов, но зато написано, как ими пользоваться, примерно вот так: «Возьмите такой-то иероглиф из корзинки номер один и поместите его рядом с таким-то иероглифом из корзинки номер два». Наблюдатель, который владеет китайским языком минимум на уровне HSK 6, передаёт ему через окошко иероглифы с вопросами. Но Джон Сёрл спокоен, у него же есть инструкция, которая составлена таким образом, что к вопросу он сможет подобрать ответ, а сам он исполняет, по сути, роль компьютера. Таким образом, у наблюдателя создаётся впечатление, что он общается с человеком, владеющим китайской письменностью. При этом Сёрл даже не имеет возможности выучить иероглифы, потому что у него нет данных об их значении. Сёрл приходит к выводу, что данная система хотя и прошла бы тест Тьюринга, но всё же не может быть принята в качестве адекватной проверки способности к мышлению. Опыт Сёрла, по сути, направлен против гипотезы «сильного» ИИ, которая утверждает, что при наличии необходимой программы машины могут приобрести способность мыслить и осознавать себя, а в данном случае — понимать естественный язык. Гипотеза «слабого» ИИ такую возможность отвергает, поэтому и полемики такой она не вызвала – не бывает таких систем, так о чем спор? Но мир всё ещё в ожидании…

Предлагаем сделать небольшое отступление и поговорить о том, как мы понимаем, что такое сознание и что это значит – осознавать себя. Обсуждение этого вопроса может выйти далеко за рамки нашей темы, поэтому просто расставим некоторые важные вехи. Джон Локк был одним из создателей новоевропейской модели сознания. На вопрос, что понимается под сознанием в его «Опыте о человеческом разумении», исследователи обычно отвечали, что это психологический феномен, свойство разума, протяженное во времени восприятие себя собой. Кроме того, Локк был создателем концепции тождества личности, согласно которой гарантией тождества является акт самосознания (моё тело и мысли меняются, но это всё ещё я): «Личность есть разумное мыслящее существо, которое имеет разум и рефлексию и может рассматривать себя как себя, как то же самое мыслящее существо, в разное время и в различных местах только благодаря тому сознанию, которое неотделимо от мышления и, на мой взгляд, существенно для мышления». Способны ли машины к осознанию себя по Локку?.. А к мышлению?..

Одним из известных методов исследования самосознания является зеркальный тест, разработанный Гордоном Гэллапом (Gallup, 1970). Однако некоторые животные также способны узнавать себя в зеркалах! А как насчет интеллектуального агента?

Другим важным критерием сознания является понятие интенциональности, которое было введено в современную философию Францем Брентано и которое подробно рассматривалось в книге с тем же названием Сёрлом – известным скептиком по отношению к ИИ (Searle, 1983). Если кратко, то состояние интенциональности — способность сознания каким-то образом относиться к вещам, свойствам и ситуациям. Например, я не просто надеюсь, а надеюсь на что-то, не просто ненавижу, а ненавижу кого-то и т. д. Сам термин происходит от латинского слова intentio, которое, в свою очередь, является производным от глагола intendere, означающего «быть направленным к какой-либо цели или вещи». Можете ли вы представить себе мечтающий или влюбленный компьютер?

Наконец, квалиа – самый загадочный аспект сознания. Термин «qualia» был введен в философскую литературу в ее современном понимании в 1929 г. Кларенсом Ирвингом Льюисом. Квалиа используется для обозначения сенсорных, чувственных явлений любого рода. Это «необычный термин для обозначения самой обычной из возможных для нас вещи: того, как вещи выглядят для нас» (Dennet, D. Quining Qualia). Один из создателей квантовой механики Эрвин Шрёдингер (да, мучитель воображаемых котов!) по этому поводу высказался так: «Ощущение цвета нельзя свести к объективной картине световых волн, имеющейся у физика. Мог бы физиолог объяснить его, если бы он имел более полные знания, чем у него есть сейчас, о процессах в сетчатке, нервных процессах, запускаемых ими в пучках оптических нервов в мозге? Я так не думаю». В нашей ли власти наделить машину квалиа? А как работает наше собственное восприятие?

Существует множество теорий сознания, которые не представляется возможным осветить здесь, хотя это действительно очень интересно (если есть такой запрос, сообщите нам, пожалуйста). Но давайте вернемся к вопросу, с которого начался разговор: может ли машина мыслить? Здесь нам хотелось бы сделать отсылку к статье Д. А. Поспелова «Моделирование рассуждений. Опыт анализа мыслительных актов» 1989 года, которую несложно найти в Интернете. Как мы говорили ранее, оба Поспеловых являются основоположниками ИИ в нашей стране. Поражают энциклопедические знания Д. А. Поспелова и то, насколько эта статья опередила свое время. Работа начинается с главы «У истоков формальных рассуждений», где автор отмечает: «Логика человеческих рассуждений, возникшая еще в Древней Греции и благополучно дожившая до наших дней, занималась и занимается лишь теми механизмами, которые характерны для левостороннего мышления. А это значит, что вне этой науки остались все способы принятия решений, опирающиеся на нерасчлененные образы правого полушария, преобразуемые сложными операциями ассоциативного типа. Вклад правосторонних механизмов в творческую деятельность огромен. Интуиция, озарение, догадка, поэтический образ — порождения правого полушария. Без этого остается лишь левое полушарие, функции которого чрезвычайно близки к функциям программиста». В работе также рассказывается о силлогистике и герменевтике рассуждений, о выводе на семантической сети и о многом другом – рекомендуем почитать.

В заключение процитируем академика Гермогена Сергеевича Поспелова: «Можем ли мы понимать термин «искусственный интеллект» буквально, или же это всего лишь некоторое метафорическое наименование целого научного направления, связанного с производством и использованием компьютеров? Я придерживаюсь последней точки зрения и считаю, что о рождении искусственного интеллекта в буквальном смысле этого слова, или, что то же самое, о создании думающих — без кавычек — компьютеров, ни сейчас, ни в обозримом будущем не может быть и речи. Поручиться за более отдаленные сроки я не берусь, так как уже неоднократно развитие науки демонстрировало поражающие воображение результаты. По-другому я мог бы выразить свою мысль так: моделирование, или имитация, мышления — это все-таки не само мышление. И поэтому предлагаю придерживаться следующего толкования понятия «искусственный интеллект»: это есть свойство компьютеров получать некоторые из тех результатов, что порождаются творческой деятельностью человека. При этом не важно, как идут в действительности эти процессы у человека, тем более что мы с абсолютной достоверностью мало что знаем по этому поводу. Важен конечный результат». На наш взгляд, максимально точное определение! Действительно, все начинается с полета творческой мысли, с концепции, которая воплощается в данном случае в компьютерной программе – да, способной к обучению, но тому, чему мы пожелаем её научить, и так, как мы обучим её. К тому же в искусственном интеллекте сейчас есть определенный набор алгоритмов, который постоянно пополняется, но некоторые из них стали классикой, а как и для каких целей мы будем их использовать – это уже настоящий творческий процесс.

Нам ближе точка зрения, что искусственный интеллект имитирует некоторые аспекты мыслительной деятельности человека и способен решать ряд его задач. А как вы думаете? Увидим ли мы машины, мыслящие и чувствующие, как человек?